参数化卷积方法及其应用

引言

深度网络结构最成功的设计之一在于卷积算子的引入。其精确刻画并有效利用了数据的平移不变性特征,实现了参数的高效共享,从而在保证表达能力的前提下降低了网络冗余度,有效减少了网络的参数容量。

然而,现阶段的卷积算子仅能精确刻画平移不变性特征,仍无法精确刻画图像数据的旋转不变性,尺度不变性,镜像不变性等常见特征,更无法灵活地进行函数变换以对卷积网络进行动态调整。这一问题归根结底是因为当下常用的卷积核是离散数组形式的,无法进行灵活的函数变换。一个自然的解决方案是改用参数化(连续化)形式的卷积核,利用连续函数灵活的可操作性解决这一问题。

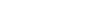

如下图的卷积核旋转实例所示,当我们得到拟合离散卷积核的连续二维函数后,卷积核的函数变换将变得容易:

1)高精度参数化卷积设计

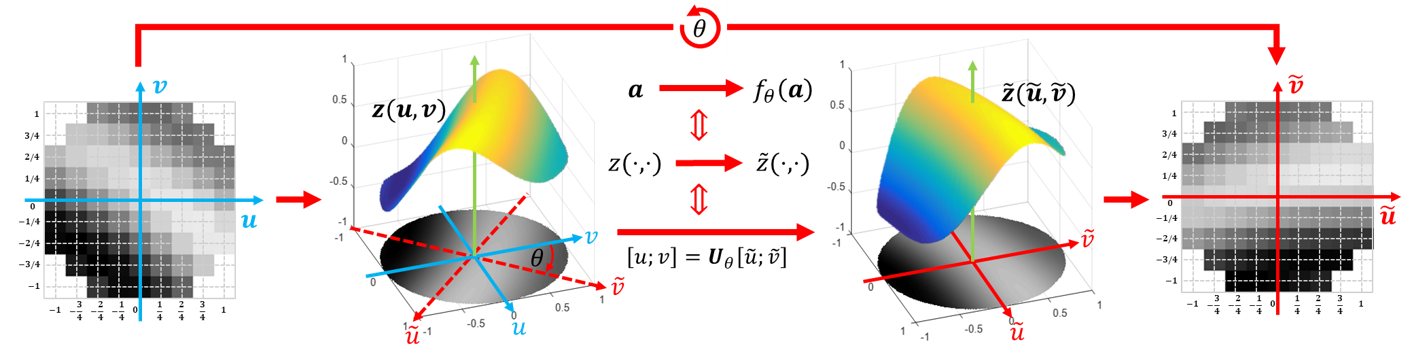

当前参数化卷积的学习主要通过如下的基底函数线性表示的形式,

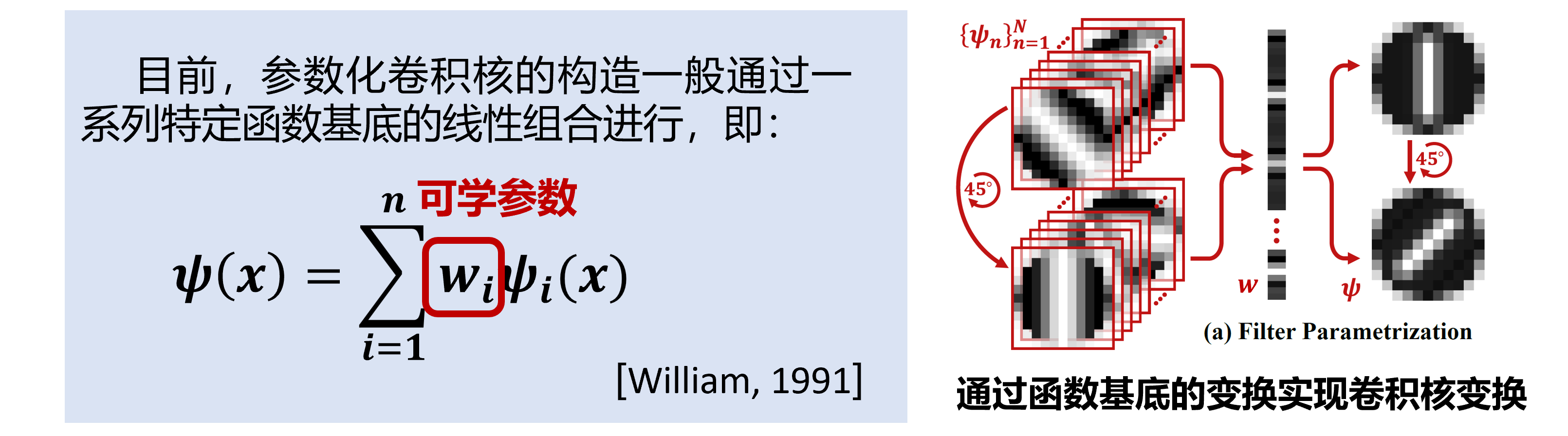

因此,基底函数的设计与选择十分重要,将极大影响参数化表示的精度。目前,在前人的工作中尚不存在精度达到底层视觉任务需求的卷积核参数化方法,导致参数化卷积这一工具无法在图像处理等一大类任务中应用。针对这一问题,我们改进了傅里叶基底,在不影响其无损精底表示能力的前提下,克服了它低化能力的问题,从而设计了高清度的参数化卷积方法,并通过实验验证所提参数化方法相比于前人方法,表示精度更高,达到底层视觉会任需求。

这一方法为高精度的旋转等变卷积、尺度等变卷积、可函数变换卷积等方法奠定了基础。

更多方法细节请参见我们的论文[1]。

代码链接:https://github.com/XieQi2015/F-Conv

2)应用于旋转等变卷积方法设计

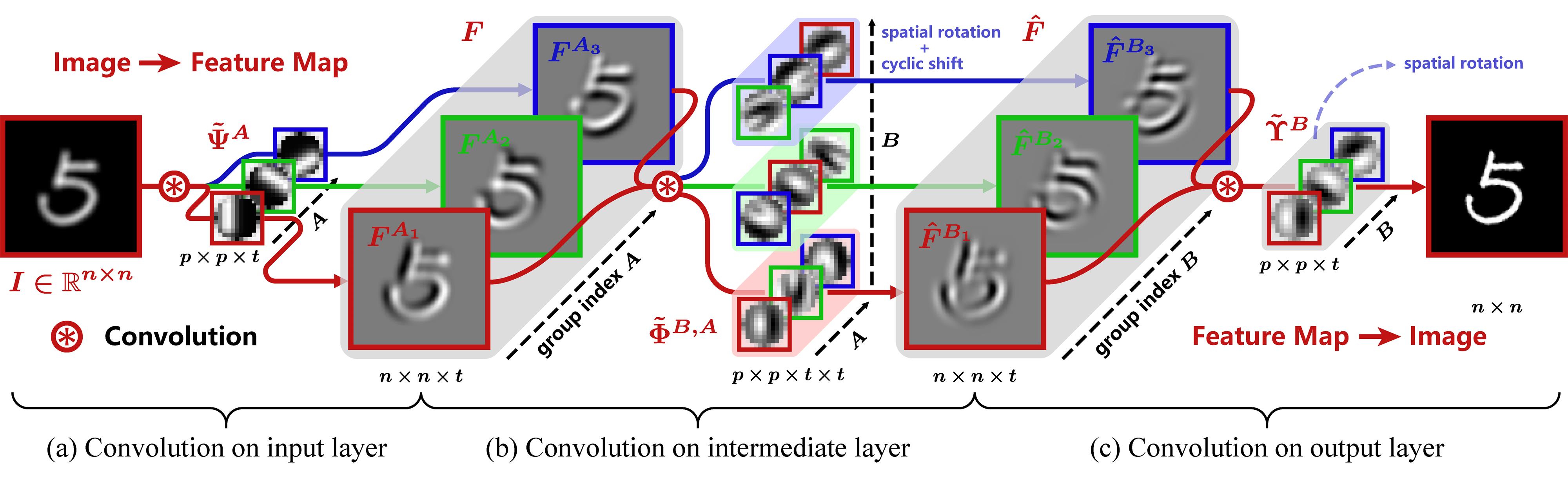

旋转等变卷积方法是近年来兴起的新型卷积方法,它将传统卷积关于平移变换等变的特性进一步推广到旋转等变。相比传统卷积,等变卷积方法已在一些领域上展示出了显著的优势以及十分可观的发展潜力。参数化卷积核的构造是等变卷积方法的核心,基于上述高精度参数化卷积方法,我们构造高精度参数化卷积方法,其架构如下图所示:

类比传统卷积层通过卷积核窗口滑动方式刻画图像局部特征的平移等变性,相比与全连接层实现了更高效的参数共享与更高的性能,所提等变卷积层通过卷积核旋转共享参数的方式进一步刻画了图像局部特征的旋转等变性,也实现了更高效的参数共享。

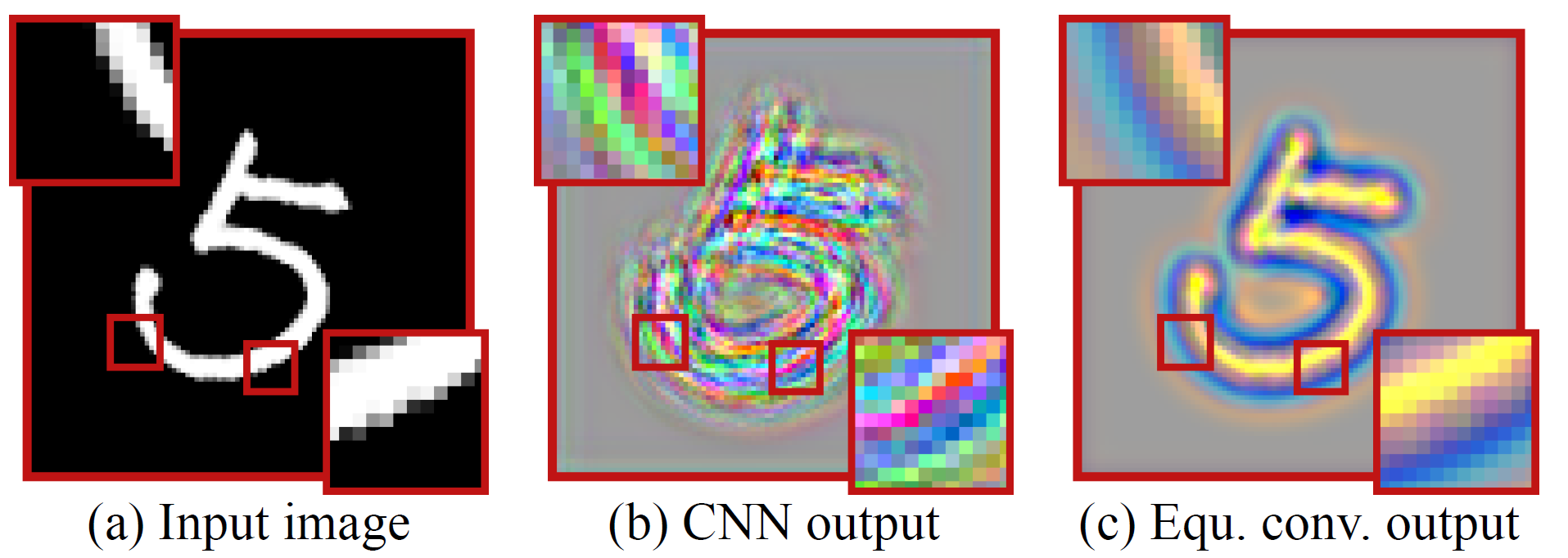

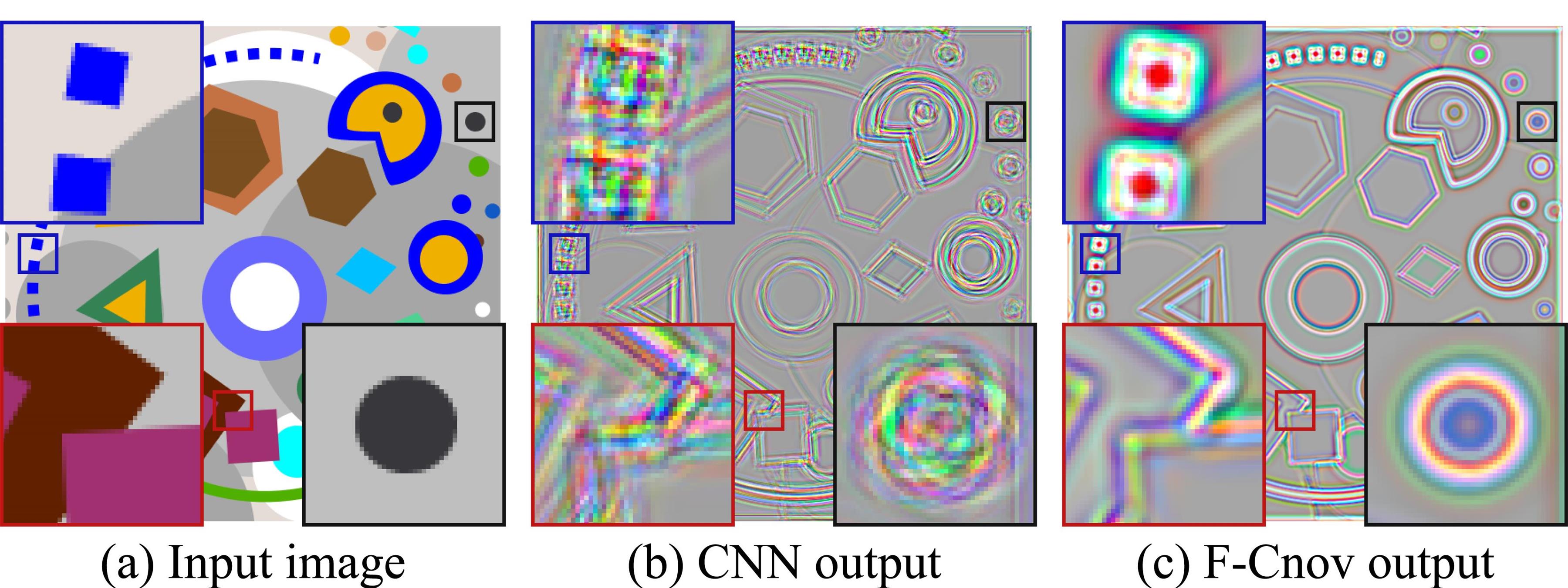

对于一大类图像处理任务,可以在不改变网络结构仅将卷积层替换为所提卷积层的方式,用更低参数量(约1/4)、相同计算内存、相同推理时间实现性能提升。下面展示在相同网络结构下,随机初始化(未经训练)的传统卷积与所提卷积输出的特征图对比:

可以看出,特征提取的过程已经发生质量,更符合实际规律。同时, 如下所示,输入特征在网络输入的旋转变换也,也显然更加稳定:

CNN结果:

所提方法结果:

这个课题之后与符佳宏合作,又有许多推进,更多方法细节请参见我们的论文[1]与[2]。

代码链接1:https://github.com/XieQi2015/F-Conv

代码链接2:https://github.com/jiahong-fu/Equivariant-Proximal-Operator

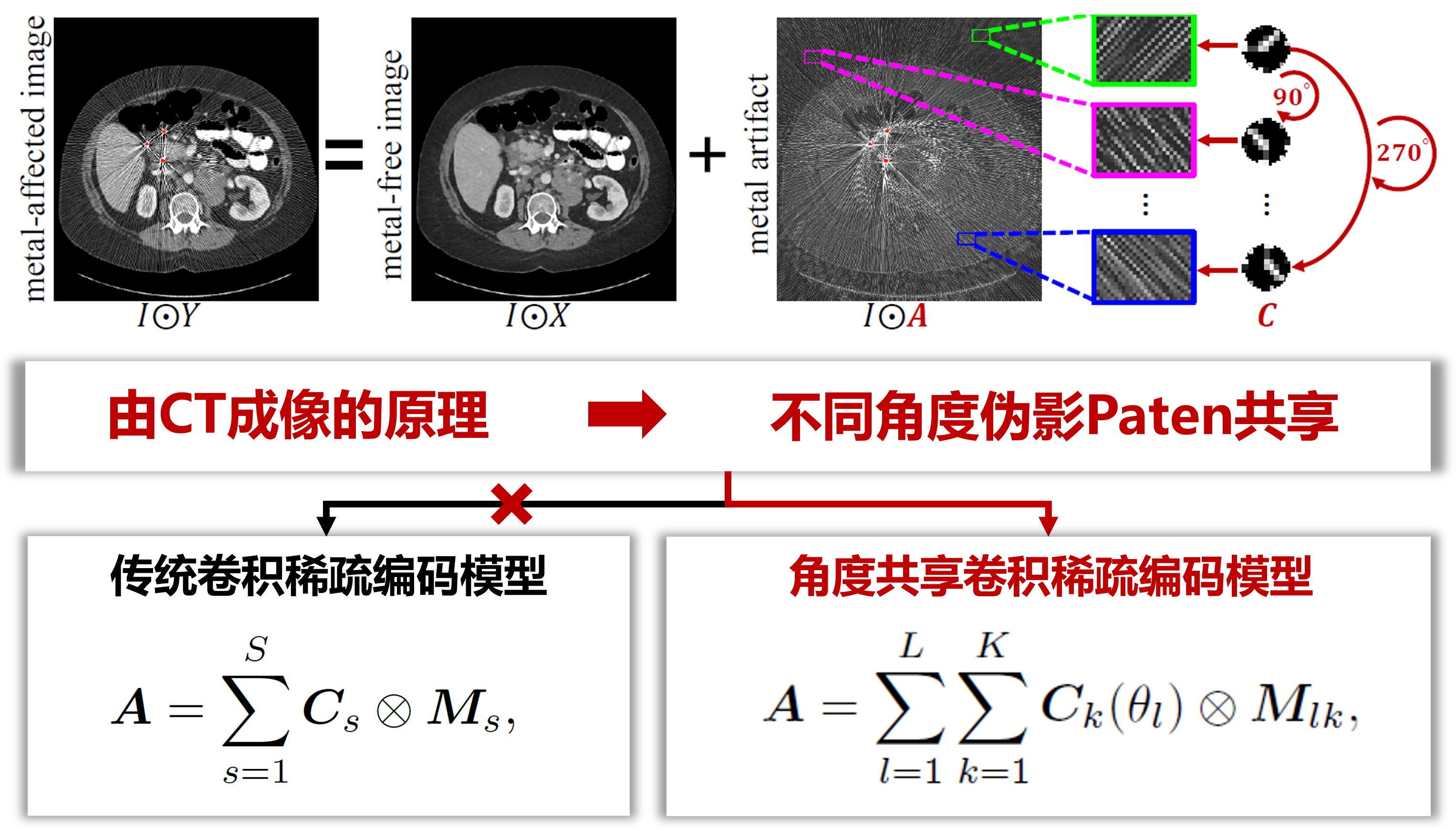

3)应用于数据建模:角度共享稀疏卷积稀疏编码模型

在CT去金属伪影任务中,金属伪影往往具有明显的线性性,适合用卷积稀疏编码模型进行建模,我们的前期工作验证了,基于卷积稀疏编码的伪影建模及其对应的模型驱动深度网络能够有效提升任务的性能。然面,如下图所示

由于CT的扫描过程是360度等变的,因此金属不同角度下的伪影应共享相同的模式。因为传统的卷积核无法自由旋转,这种模式共享特征无法使用传统的卷积稀疏编码模型进行建模。

针对这一问题,我们利用了所提参数化卷积方法可旋转特性,构造了全新的角度共享稀疏卷积稀疏编码模型,仅需相对前期工作进行伪影模型的替换和极少量的网络改进,即能有效进一步提升任务性能。

代码链接:https://github.com/hongwang01/OSCNet

4)应用于动态网络设计:可解释雨图生成网络

雨图生成可以用于基于深度学习去雨方法的训练数据增强,进一步可以在自动驾驶等应用中使用。

近年来出现了使用对搞生成的方式来生成带雨图片,但是性能仍有很大的提升空间。

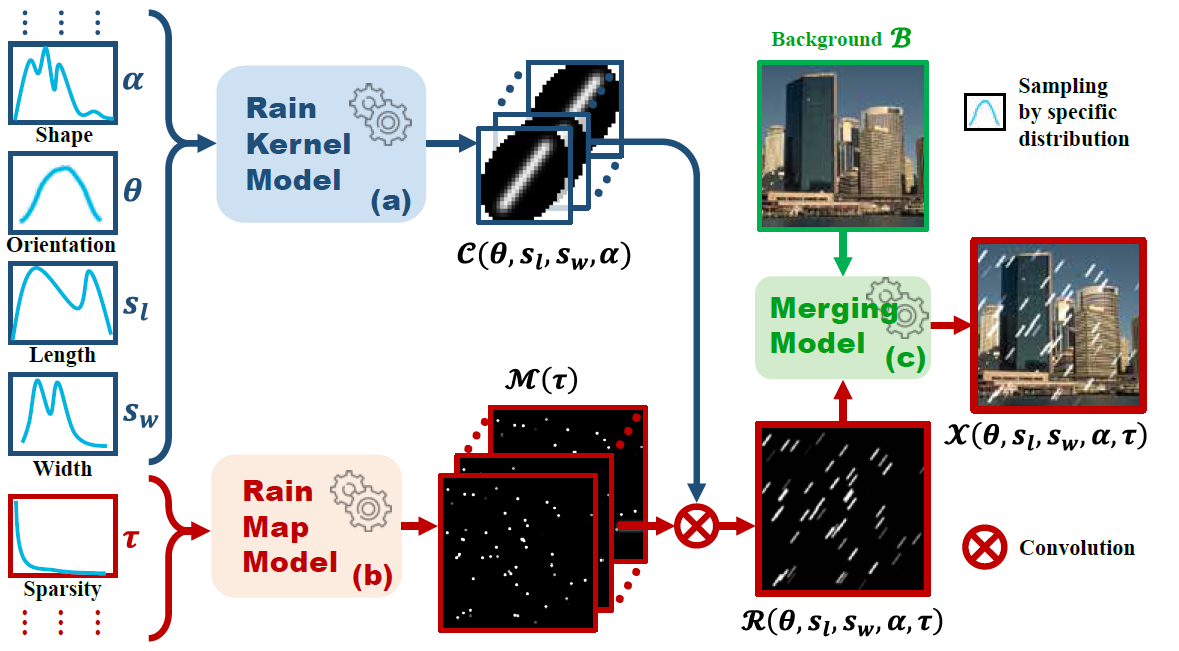

我们认为,雨的分布是相对可以理解的,可以靠人工的建模减轻学习的压力,实际上,生成带雨的图片并不困难,例如,艺术家利用PS软件,经过几个简单的步骤,就可以为图片加上雨层 (https://www.bilibili.com/video/BV1nv411172e/)。这种方式生成的雨层虽然符合人类的肉眼直观,但它与实际数据的雨层仍有区别,用于训练数据或训练时一般效果不佳,但无论如何,它提供了一个很可靠的雨的生成的大体框架,如下:

可以看到,这个框架合理又可理解地生成了雨层。

如果能把这个框架可学习化,用深度网络进一步补人工设计的框架在细节上与实际数据情况的差距,那就能得到一个理想的雨生成模型。但很快我们就会发现,这件事其实是困难的,因为要实现这个框架的可学习化,需要学习雨核的形状、长度、宽度、角度等特征的分布,其中长度、宽度、角度这几个参数都无法在传统的卷积核中实现动态调整,更不用说学习了。

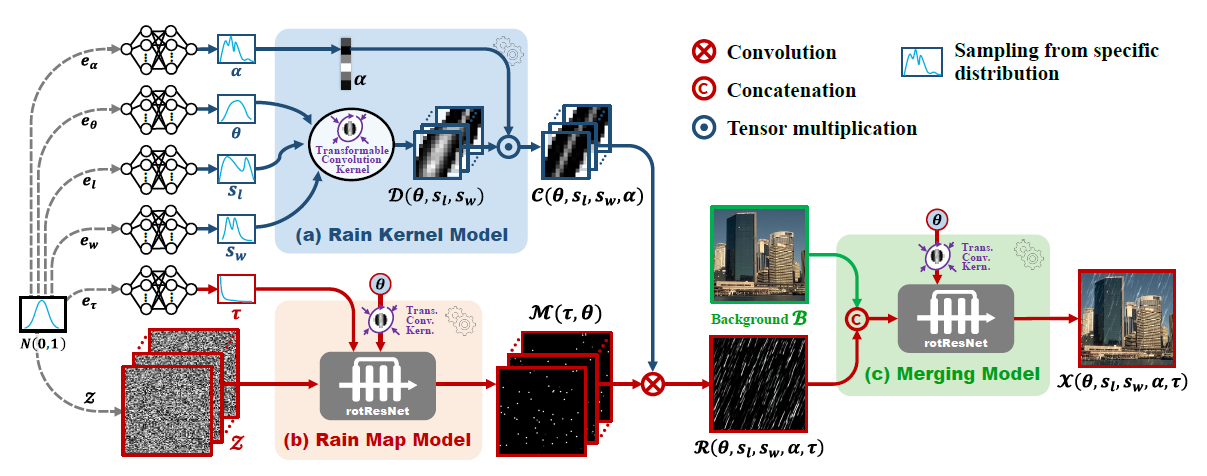

幸运的是,基于参数化卷积方法,我们是可以实现这个功能的,因为参数化卷积方法中,卷积核是连续函数,长度、宽度、角度等形变参数是很容易以坐标变换的参数的形式作用到卷积核上的,我们可以由此实现如下的网络构造:

其中,前向过程中,长度、宽度、角度等形变参数通过参数化卷积作用到雨核上。在训练过程中,也可以通过梯度反传训练生成这些参数的轻量级生成网络(以高斯分布为输入的一到二层全连接网络)。

由于这个网络以一个可行的可解释框架为骨架,学习难度很低,可以在极少的训练步中,达到远超纯黑箱网络的大量训练步的性能,如下图所示:

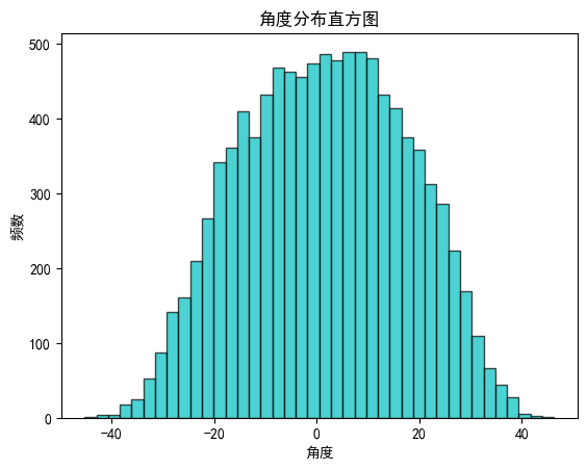

同时,还能首次实现角度等物理参数的分布学习,并在训练完成后,通过输入给定参数,人为调整生成的雨角度,长度等。如下图以角度和长度为例:

这个方法还有很多有趣的新功能与设计,可以说是我最喜欢的自己的工作之一了(虽然被评价雨生成不是什么意义重大的课题),在做完初步实验后,这个工作主要由庞智强接手推进,详见论文 [5]。

代码链接:https://github.com/pzq-xjtu/TRG-Net

参考论文:

[1] Xie Qi, Zhao Qian, Xu Zongben, Meng Deyu. Fourier Series Expansion Based Filter Parametrization for Equivariant Convolutions. IEEE Transactions on Pattern Analysis and Machine Intelligence (TPAMI). 2022. (高精度旋转等变卷积的首篇论文)

[2] Jiahong Fu, Xie Qi*, Meng Deyu, Xu Zongben. Fourier Series Expansion Based Filter Parametrization for Equivariant Convolutions. IEEE Transactions on Pattern Analysis and Machine Intelligence (TPAMI). 2024. (应用到Unfolding网络,理论进一步完善)

[3] Wang Hong, Xie Qi*, Li Yuexiang, et al. Orientation-Shared Convolution Representation for CT Metal Artifact Learning[C]. MICCAI, 2022

[4] Wang Hong, Xie Qi, Zeng Dong, et al. OSCNet: Orientation-Shared Convolutional Network for CT Metal Artifact Learning[J]. IEEE Transactions on Medical Imaging, 2023.

[5] Pang Z, Wang H, Xie Q*, et al. TRG-Net: An Interpretable and Controllable Rain Generator[J]. arXiv 2024.